[방송기술저널=박성환 박사, EBS 자기주도학습센터장] AI 기술이 미디어 테크놀로지 전반을 재편하는 가운데, 차세대 인터페이스 경쟁의 중심은 더 이상 스마트폰에 머물지 않는다. 메타가 안경형 AR에 집중하고, 애플이 카메라를 내장한 이어폰과 비전 프로(Vision Pro)의 연계를 모색하는 흐름은 하나의 방향을 가리킨다. ‘AI 글래스’가 미래 인터페이스로 주목받고 있지만, 정작 현실에서는 그 대안으로 “이어폰형 AI”가 더 빠르게 자리 잡을 가능성이 커지고 있다.

AI 글래스의 한계, 그리고 지연되는 온디바이스 AI

AI 글래스는 시각 정보와 AI를 결합한 가장 직관적인 장치다. 하지만 기술적 제약은 여전히 크다. 가장 큰 문제는 무게와 배터리다. 고성능 온디바이스 AI를 구현하기 위해서는 상당한 연산 자원과 발열 관리가 필요하며, 이는 착용형 기기의 경량화와 정면으로 충돌한다. 또한 카메라 기반 고해상도 영상 처리와 클라우드 연동은 프라이버시 논란을 피하기 어렵다. 이러한 이유로 AI 글래스는 “가능한 미래”로 남아 있지만, 대중화까지는 시간이 필요하다. 특히 일상에서 항상 착용해야 하는 기기라는 점에서 사용자의 심리적 저항도 무시할 수 없다.

이어폰에 눈을 달다: VueBuds의 실험

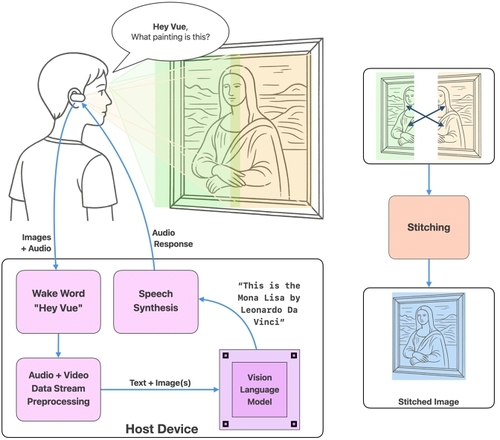

이와 대비되는 접근이 바로 이어폰이다. 2026년 4월 CHI 컴퓨팅 시스템 인간공학 학술대회에서 발표된 VueBuds 연구(웨어러블, 오디오 및 새로운 인터랙티브 장치)는 무선이어폰에 초소형 카메라를 탑재해 사용자의 시각 정보를 AI와 연결하는 새로운 방식을 제안했다. 이 시스템은 “보는 능력”을 안경이 아닌 귀에 부착된 기기로 구현한다는 점에서 기존 접근과 근본적으로 다르다. VueBuds는 시각 언어 모델을 활용해 사용자의 음성 및 쌍안경 카메라 데이터를 처리하여 실시간 다중 모달 상호작용을 지원한다. VueBuds는 고해상도 영상 대신 저해상도 흑백 정지 이미지를 활용해 전력 소모를 최소화했다. 블루투스를 통해 스마트폰과 연결되며, 대부분의 처리는 로컬 디바이스에서 이루어진다. 사용자가 “이거 번역해 줘”라고 말하면, AI는 카메라가 포착한 장면을 분석해 즉각적으로 응답한다. 성능 역시 주목할 만하다. 번역 및 물체 인식 정확도는 약 83~84%, 책 제목과 저자 인식은 93% 수준을 기록했다. 이는 상용화 초기 단계의 프로토타입임을 고려하면 충분히 의미 있는 수치다.

프라이버시와 현실성: 이어폰이 가진 결정적 장점

이어폰형 AI의 가장 큰 강점은 현실적인 사용성이다. 이어폰은 이미 전 세계적으로 보편화된 디바이스이며, 사용자에게 추가적인 착용 부담을 주지 않는다. 반면 스마트글래스는 착용 여부 자체가 진입장벽으로 작용한다. 또한 VueBuds는 프라이버시 문제를 해결하기 위한 설계가 돋보인다. 저해상도 이미지 사용, 온디바이스 처리, 촬영 시 표시등 활성화, 즉시 삭제 기능 등은 기존 AI 글래스가 지적 받아온 감시 우려를 상당 부분 완화한다. 이러한 특성은 “항상 켜져 있지만 부담스럽지 않은 AI”라는 새로운 사용자 경험을 가능하게 한다.

출처 : https://dl.acm.org/doi/10.1145/3772318.3791322

‘듣는 기기’에서 ‘이해하는 기기’로

이어폰은 더 이상 단순한 오디오 장치가 아니다. 공간 음향, 노이즈 캔슬링을 넘어 이제는 시각 정보와 행동 맥락까지 이해하는 센서로 진화하고 있다. 귀에 착용된 위치는 사용자 시선과 거의 일치하는 방향성을 제공하며, 5~10도 각도 조정만으로 약 100도에 달하는 시야 확보도 가능하다. 이러한 특성은 이어폰을 “항상 활성화된 AI 인터페이스”로 만든다. 스마트폰을 꺼내지 않아도 주변 사물 인식, 번역, 정보 검색이 자연스럽게 이루어진다. 결국 인터페이스는 화면 중심에서 음성+맥락 중심으로 이동하게 된다.

출처 : https://dl.acm.org/doi/10.1145/3772318.3791322

XR 생태계와의 연결, 그리고 스마트폰 이후

이어폰형 AI는 단독 기기를 넘어 XR 생태계와 결합할 때 더 큰 잠재력을 가진다. Vision Pro와 같은 MR 헤드셋과 연동될 경우, 이어폰은 입력 장치이자 환경 인식 센서로 기능하며 공간 컴퓨팅 인터페이스를 확장한다. 중요한 점은 이 변화가 스마트폰을 점진적으로 대체할 수 있다는 것이다. 스마트폰이 “손에 들고 보는 기기”라면, 이어폰형 AI는 “몸에 착용하고 느끼는 인터페이스”다. 사용자는 더 이상 화면을 확인하기 위해 시선을 분산시키지 않아도 된다.

가장 현실적인 미래 인터페이스

AI 글래스는 여전히 매력적인 비전이다. 그러나 기술적, 사회적 장벽을 고려할 때 대중화까지는 시간이 필요하다. 반면 이어폰형 AI는 이미 존재하는 플랫폼 위에서 점진적으로 진화할 수 있다. VueBuds가 보여준 가능성은 단순한 실험이 아니다. 그것은 “AI는 반드시 눈앞에 있어야 하는가?”라는 질문에 대한 새로운 답이다. 어쩌면 미래의 AI 인터페이스는 우리가 보고 있는 곳이 아니라, 우리가 듣고 있는 곳에서 시작될지도 모른다.

스마트폰 이후의 시대는 생각보다 조용하게, 그리고 귀 가까이에서 시작되고 있다.